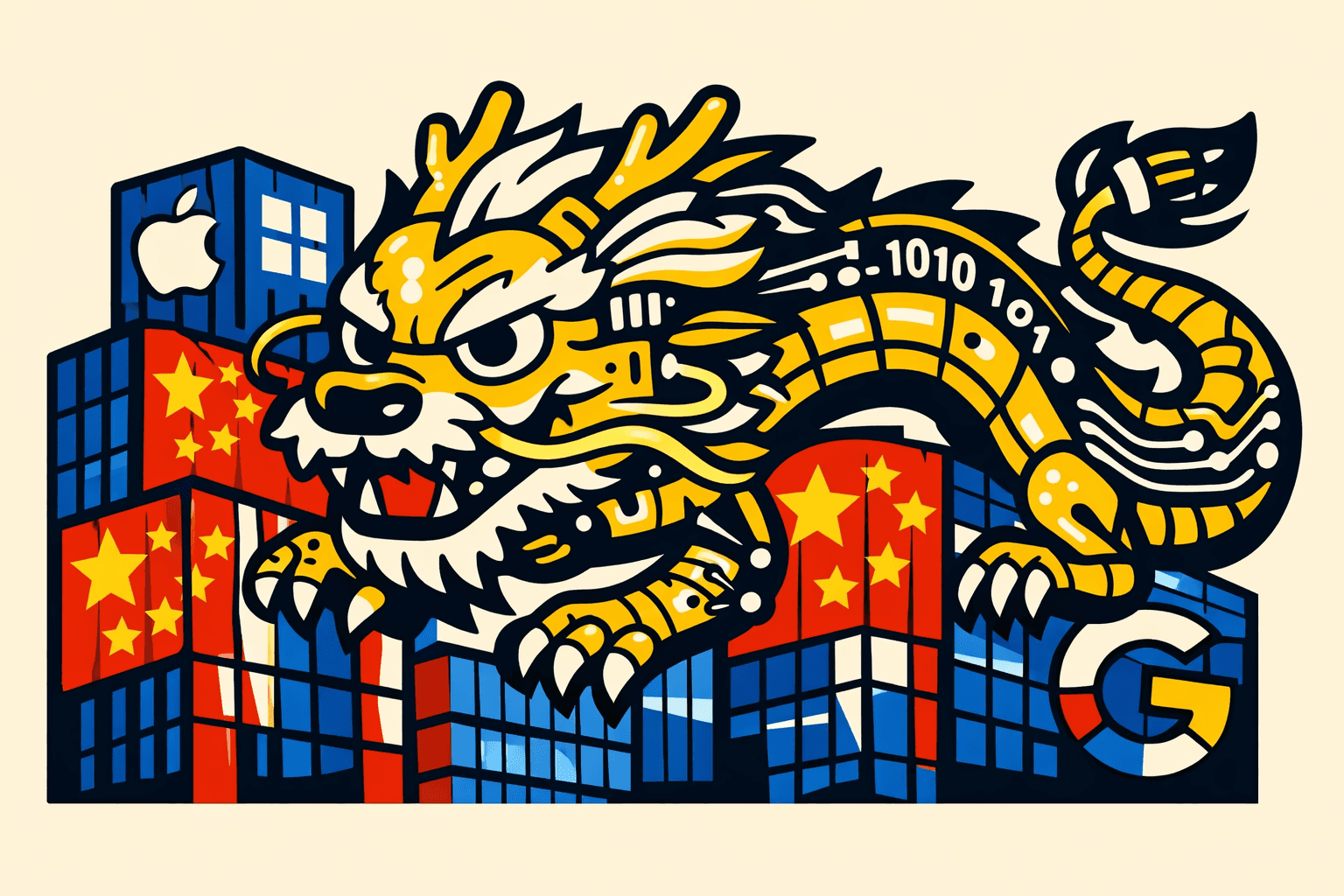

Il y a tout juste un an, une startup chinoise inconnue du grand public faisait trembler la Silicon Valley. DeepSeek, basée à Hangzhou, avait dévoilé son modèle R1, un système de raisonnement si performant que le capital-risqueur Marc Andreessen l'avait qualifié de "moment Spoutnik de l'IA". Ce vendredi 24 avril, l'entreprise a remis le couvert avec une ambition décuplée : deux nouveaux modèles, DeepSeek V4-Pro et DeepSeek V4-Flash, qui bousculent à nouveau toutes les certitudes de l'industrie.

Des performances de pointe, un prix plancher

Les chiffres donnent le vertige. V4-Pro embarque 1 600 milliards de paramètres dont 49 milliards actifs simultanément grâce à une architecture Mixture of Experts, et digère jusqu'à un million de tokens de contexte — contre 128 000 pour la génération précédente. Sur le benchmark SWE-bench, référence pour évaluer la capacité d'un modèle à résoudre de vrais bugs logiciels, V4-Pro atteint 80,6 %, à seulement 0,2 point de Claude Opus 4.6 d'Anthropic. Mais le véritable coup de tonnerre, c'est le prix. Là où GPT-5.4 d'OpenAI facture 2,50 dollars le million de tokens en entrée et 15 dollars en sortie, et où Claude Opus demande respectivement 5 et 25 dollars, DeepSeek propose V4-Pro à 1,74 dollar en entrée et 3,48 dollars en sortie. Le modèle Flash, plus léger, descend même à 0,14 dollar le million de tokens en entrée. Des tarifs qui rendent les modèles les plus avancés accessibles à n'importe quel développeur ou petite entreprise.

L'art chinois de faire mieux avec moins

Ce qui frappe le plus dans cette annonce, c'est l'efficacité redoutable de l'approche DeepSeek. Selon plusieurs analystes, le coût d'entraînement de V4 est estimé à environ 5,2 millions de dollars, une fraction des budgets de 100 millions et plus que dépensent habituellement les laboratoires américains pour des modèles de cette envergure. L'entreprise a également réussi à réduire de 73 % les calculs nécessaires pour générer un token et de 90 % la mémoire cache par rapport à son prédécesseur. Autre fait notable : V4 fonctionne en partie sur des puces Huawei Ascend, démontrant qu'il est possible de construire des modèles de pointe en dehors de l'écosystème Nvidia, malgré les restrictions d'exportation américaines sur les semi-conducteurs avancés vers la Chine.

Un signal géopolitique autant que technologique

DeepSeek publie ses deux modèles en open source sous licence MIT, permettant à quiconque de les télécharger, les modifier et les déployer librement. Ce choix stratégique contraste avec la tendance croissante des laboratoires occidentaux à restreindre l'accès à leurs modèles les plus puissants pour des raisons de sécurité. Le rapport Stanford AI Index 2026, publié plus tôt ce mois-ci, confirme que la Chine a "effectivement comblé" l'écart de performance avec les États-Unis, tout en dominant déjà en volume de publications scientifiques, de citations et de brevets. DeepSeek admet lui-même que V4-Pro accuse un retard de trois à six mois sur les tout meilleurs modèles fermés comme Gemini 3.1-Pro de Google. Mais avec un tel rapport qualité-prix et une ouverture totale du code, la question n'est plus de savoir si la Chine peut rivaliser avec la Silicon Valley dans la course à l'IA — c'est de savoir combien de temps l'avance américaine peut encore tenir.