Anthropic vient de frapper un grand coup. Le 8 avril, la société a dévoilé Claude Managed Agents, un service cloud qui permet aux entreprises de déployer des agents IA autonomes sans se soucier de l'infrastructure. Concrètement, là où il fallait des mois pour passer d'un prototype d'agent à un produit en production — avec tout le casse-tête des conteneurs, de la sécurité et de la montée en charge — Anthropic promet désormais de réduire ce délai à quelques semaines. Notion, Rakuten et Asana font partie des premiers clients à avoir intégré le service dans leurs produits.

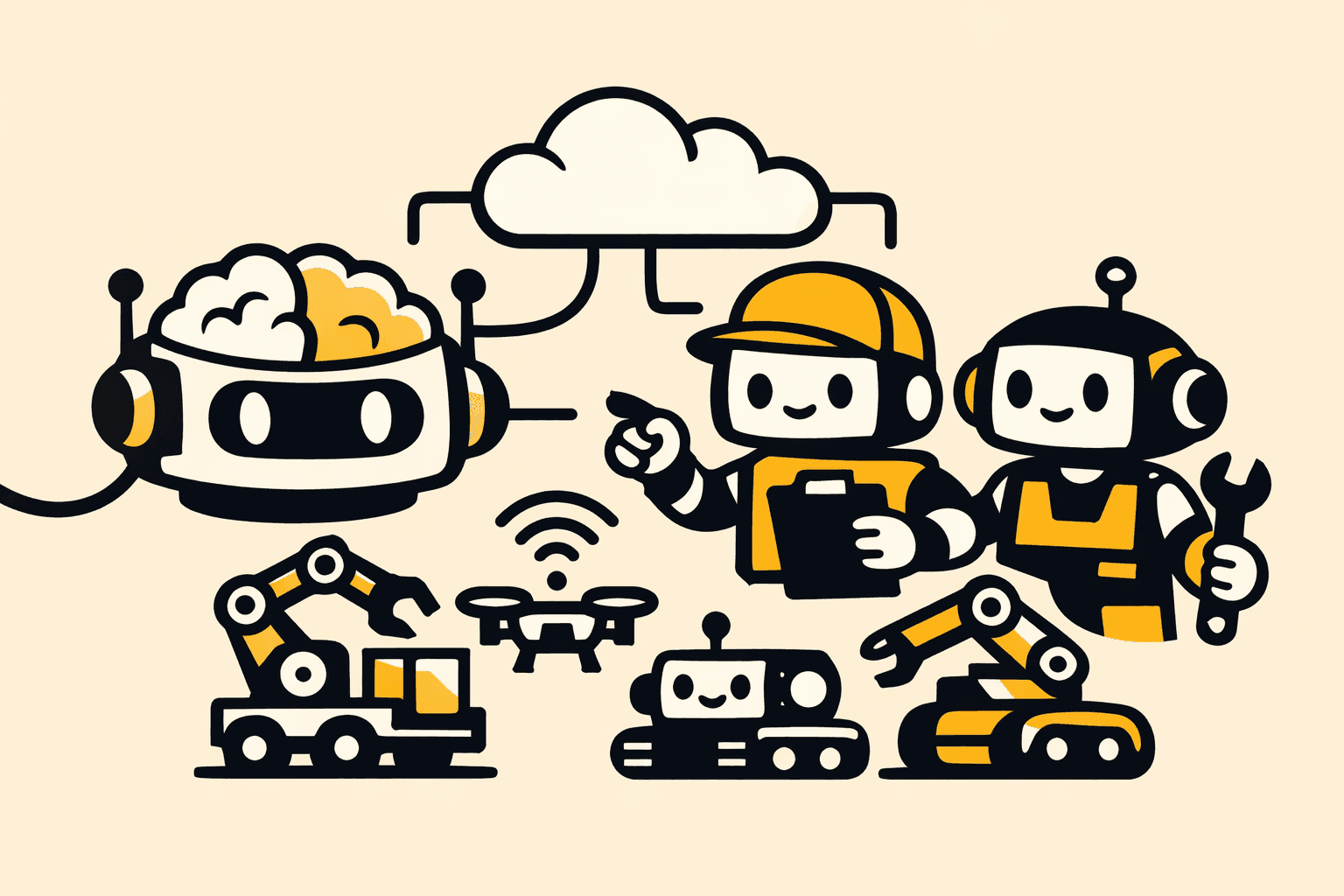

Une architecture qui sépare le cerveau des mains

L'idée centrale est aussi élégante que radicale. Anthropic a découpé l'architecture de ses agents en trois composants indépendants : la session, un journal qui enregistre tout ce que fait l'agent ; le harness, la boucle qui appelle Claude et orchestre les outils ; et le sandbox, l'environnement isolé où le code s'exécute. Cette séparation permet de remplacer un conteneur défaillant sans perdre le fil de la conversation, de relancer un agent exactement là où il s'était arrêté, et surtout de faire évoluer chaque composant indépendamment. Les ingénieurs d'Anthropic comparent cette approche à celle d'un système d'exploitation : des abstractions stables qui survivent aux changements matériels.

Sécurité, performance et sous-agents

Côté sécurité, les identifiants et tokens OAuth ne sont jamais exposés aux sandboxes qui exécutent le code généré par Claude — ils transitent par un proxy sécurisé authentifié par des tokens de session. Les résultats en termes de performance sont impressionnants : le temps avant la première réponse a chuté de 60 % en médiane et de plus de 90 % au 95e percentile, simplement en éliminant le provisionnement obligatoire de conteneurs au démarrage. Autre fonctionnalité remarquable encore en preview : les agents peuvent désormais engendrer d'autres agents pour traiter des sous-tâches complexes, avec un système de raffinement automatique des prompts qui améliore le taux de réussite de 10 points.

Un modèle économique transparent, mais qui peut chiffrer

Le pricing se veut simple : on paie les tokens Claude au tarif standard de l'API, plus 0,08 dollar par heure de session active (facturée à la milliseconde, le temps d'inactivité ne compte pas) et 10 dollars pour 1 000 recherches web. Un modèle transparent qui pourrait toutefois s'avérer coûteux pour les usages intensifs — certains développeurs crypto ont déjà signalé des factures journalières entre 1 000 et 5 000 dollars pour des sessions d'agents autonomes prolongées.

La course aux agents est lancée

Avec ce lancement, Anthropic ne se contente plus de vendre un modèle de langage : l'entreprise devient un fournisseur d'infrastructure pour agents autonomes, en concurrence directe avec les Agent SDKs d'OpenAI et le framework ADK de Google. Le pari est clair — dans un monde où Gartner estime que 40 % des applications métier utiliseront des agents IA d'ici fin 2026, celui qui maîtrisera la couche d'orchestration et d'exécution tiendra une position stratégique. Reste à voir si les entreprises préféreront confier leurs agents à Anthropic ou garder la main sur leur propre infrastructure. Une chose est sûre : l'ère où l'IA se contentait de répondre à des questions est définitivement révolue.